はじめに

こんにちは、ふたばとです。

2025年3月9日に開催された2024年度SecHack365成果発表会をもって、2022年からお世話になったSecHack365での3年間の活動に一区切りがつきました。

2024年度も #SecHack365 成果発表会を無事に終えることができました!トレーニーの思想や関心、創意の結晶を肌で感じ取ってもらえましたでしょうか。本当に素敵な方々に恵まれ、アシスタントを2年間全うできました。人の成長はこの上なく尊く、これを特等席から見届けられたことは至福の体験でした。 pic.twitter.com/T3OGlhPs18

— ふたばと (@01futabato10) 2025年3月9日

この3年間、SecHack365を通じて、本当に多くのことを経験させてもらいました。 この3年の中には、インターン、コンテスト、大学院入試、専門学校卒業、短期留学、学会発表、就職活動、修士論文、大学院卒業など、さまざまなイベントもありました。 常に何かに追われ続けるような充実した日々ではありましたが、同時にさまざまな葛藤を抱え、藻掻き続けるような日々でもありました。

生きることは苦しく、「いつ終わっても構わない」と思っていた時期もありました。 それでも、生きるなら、「何が自分を苦しめているのかを知る必要がある」と感じ、SecHack365の中で日報という形で内省を始めるようになりました。

私の場合、"モヤモヤ"を放置することが自己否定を引き起こしてしまう原因になっていたので、日報の中でなんとか"モヤモヤ"を言語化することで具体的な解決策が得られないかを模索していました。

この3年間の内省と記録を通じて、私が何に迷い、何を諦め、何を信じていたのかを振り返り、整理してみます。 SecHack365への感謝の気持ちと私自身の歩みを重ねて、ひとつの区切りとして記しておきたいと思いました。

SecHack365とは何かに関しては、公式のコース概要ページや、他の修了生のブログをご覧いただけると幸いです。

重ねての言及になりますが、本稿はSecHack365の活動紹介ではありません。 SecHack365の中で日々投稿していた日報を軸に、トレーニー、そしてアシスタントとして過ごした3年間を通じて、私の青春時代に蹴りをつける私的な随筆です。

- はじめに

- SecHack365の振り返り

- Absurd Meditations

- 自分を乗りこなす

- 豊かさの中に生まれる空虚感

- 不条理の先にあるもの、残酷さへの向き合い方

- "モヤモヤ"の言語化

- 自分を護る習慣

- おわりに

SecHack365の振り返り

本題に入る前に、まずはSecHack365で過ごした3年間を振り返っておきたいと思います。 この振り返りは、後に語る内省や心情の変化を追うための前提としての記録でもあります。

何もうまくいかなかったトレーニー時代から、立場がアシスタントへ変わる中で、私の役割も、視点も、心の在り方も少しずつ変化していきました。

ここでは、そうした立場と視点の移り変わりを軸に、SecHack365という場の中で私がどのように揺れていたのかをできるだけ素直に記します。

トレーニー時代

応募書類にはありったけを詰め込んで、自分にできることをすべてやり切ったうえで送りつけることができたので、合格通知を受け取ったときはとても嬉しかったのを覚えています。

応募課題を書く過程では、自分と向き合う時間を強いられます。 それでも、どうしても逃げ出したくなかった気持ちがありました。 私はセキュリティ・キャンプの参加経験があるわけでもなく、学外活動で目立った実績があったわけでもなかったので、学生期間最後のチャンスとしてSecHack365には何としても通りたいと強く意気込んでいました。

しかし、そこにあった活力は、純粋に「何かを作りたい」から生まれたものではなく、"何も持ち合わせていない自分"が嫌で、自分を奮い立たせていたことを覚えています。 もちろん、テーマそのものには興味がありましたし、SecHack365に応募する以前から取り組んでいたものになりますが、正直なところ「SecHack365のトレーニーになること」自体をステータスのように捉えていました。

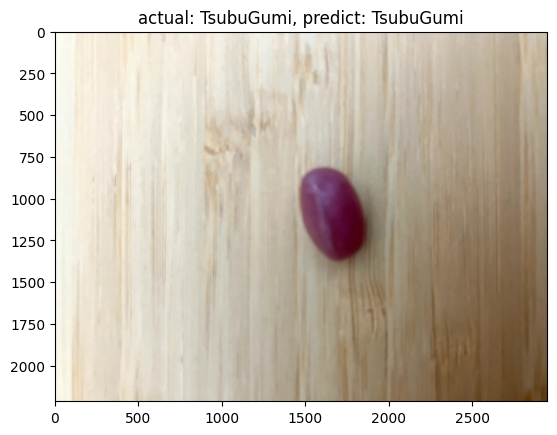

合格したからには"成果"を出したいと意気込んでいましたが、その"成果"とは何かが曖昧でした。 研究も初めてで、わかりやすい目標といえば「論文化」くらいしか思い浮かびませんでした。 過去にSecHack365に応募して不合格になった経験があったこともあり、「今回も落ちた人がいる」と思うと、「何も成果がありませんでした」とは絶対に言いたくない、責任感にも似た気持ちがありました。

しかし、時が経つにつれて、その強い気持ちは徐々に空回りしていきました。 修了が近づいた頃には、私は「何も成果がありませんでした」の札を掲げていました。

記録を取り、コースワークにもすべて出席していたので、本当に何もしていなかったわけではないはずですが、それでも「研究として何が課題なのか」を見つけることに苦しみ、成果と呼べるものを掴めずにいました。 最も避けたかったはずの成果の無い状態に、自分が陥っていました。

研究分野の進展は早く、レッドオーシャンに飲み込まれていて、調査をしてもしても終わりが見えず、思いつくアイデアは既に誰かにやられていて、やればやるほどに「研究は自分には無理だ」と思い知らされ、八方塞がりになっていました。

追試や実装にも手間取り、実験の試行錯誤の過程も楽しめずに、論文が書けるような成果を出すという自己実現に憧れてばかりでした。 発表資料を作ろうにも、何も話せることがなく、結局すべて誰かの焼き直しで、「自分がやったことなんて何もない」と、自分で自分を追い詰める日々でした。

焦りだけが先走り、ストレスで頭痛と吐き気が止まらずにトイレでぐったりしていた記憶もあります。 うまく助けを求められないまま、成果発表動画の締め切り日を迎えてしまいました。

成果のない自分が、ただただ恥ずかしくて仕方ありませんでした。 何よりも、指導してくださっていた方々に申し訳なさが募り、苦しかったです。

「自分は修了に値しない」と本気で思っていたので、潔く動画を提出しなければよかったのに、薄汚い自分が"修了する権利"を求めて、よくわからない動画を提出してしまいました。

誰にも見られたくないような、恥ずかしい動画でした。

その翌週のオフラインイベントも、会場に向かう途中で何かと理由をつけて何度も家に引き返そうと思いました。 でも、引き返してサボるほうがもっと苦しいと感じた私は、なんとか会場までたどり着き、イベントデイに参加することにしました。

自暴自棄になってしまっていたので、周囲に合わせる顔はありませんでしたが、皆は優しく労ってくれました。 特にトレーナーからは、「自分を卑下しないで欲しい」と直接じっくりと諭してもらいました。

ここで私は、「傲慢は自分を下げるが、卑下はコミュニティ全体を下げる」という大切なことを学びました。 度を越える卑下は、謙虚の域を超えて、個人の問題に留まらず、コミュニティや応援してくれている周囲の人をも傷つけてしまうのだということを実感しました。

そして私はようやく、他者に助けを求めること、他者に悩みを打ち明けることを少しずつ試みるようになりました。

それまで私は、人とつながることを避けて、独りよがりであろうとしていました。 "あの頃"の人生のどん底から這い上がるために、俗世との距離を取り、自分は幸福を望む権利がないということを本気で唱え続けていました。 「遊んでいる暇なんてない」と、誰ともつながろうとしないまま生きてきた結果、誰ともつながれなくなってしまっていました。

でも、独りでは生きられません。 私にすべてを曝け出す強さはありませんが、それでも私を救ってくれる人たちが、SecHack365のコミュニティにはいました。

そして、お世話になったSecHack365に自分が貢献するために、ポスター制作をやり切って、成果発表会を笑顔で迎えようと決意しました。 また、せっかくの大学院進学も、進学を半ば諦めていましたが、SecHack365での1年を終点ではなく通過点として捉え、ここで学んだことを4月以降につなげていこうと、意識を改めることにしました。

日報は単にタスクを記録するものでしかありませんでしたが、この頃から自己認識の歪みを矯正する道具になっていきました。

アシスタント時代

SecHack365というコミュニティは温かく、私はとても好きでした。 だからこそ、アシスタントという役割にも興味はありました。

しかし、ここまでの話からもわかるように、私はトレーニー時代の自分の作品について語ることを執拗に避けようとしてしまいます。 優秀修了生でもなく、むしろ「お情けで修了させてもらった」とすら思っている自分にとって、「トレーニーのとき何を作っていたのか?」と聞かれることが今もとても怖いです。 そんな自分が、トレーニーを支える立場であるアシスタントを務める資格があるとは、とても思えませんでした。

大学院に進学すれば、学業で忙しさに身を任せることができるし、新しい環境で気持ちを切り替えようと考えていたところに、トレーナーからアシスタントとして活動しないかと声をかけていただきました。

正直戸惑いもあり、もにょもにょした返事をした私に対して、トレーナーが「やってみたいならWelcomeです」と言ってくださったので、アシスタントを承諾させていただくことにしました。

私にとって何事も、やるからにはそれ相応の覚悟が必要です。 私には、自分にできる限りこの役割に向き合い、最後まで全うすると覚悟を決めて取り組むことにしました。

アシスタント1年目

初回のコースワークから、苦しかったのを覚えています。 トレーナーの知識や視座、アイデア、洞察力のすべてが圧倒的であることを改めて実感しました。 自分が何かコメントしようとしても、既にトレーナーがそれを遥かに洗練された言葉でコメントされるし、トレーナーに先にコメントされると、もう自分には何も言えなくなり、コメントを捻り出すことすらできませんでした。

ようやく捻りだすようなコメントも、内容以前に相手や状況を思いやる余裕はなく、どうにかコメントしなければならない状況を抜け出すのに精一杯でした。 だからこそではありますが、「トレーナーならどんなコメントをするだろう」と考えるようにはなりました。 トレーナーに近い距離でこうした学びを得られる環境は本当にありがたいものとは理解できていたので、自分がうまくフィードバックできるはずだという幻想は捨てて、「自分にできることをしよう」と言い聞かせるようになりました。 こうして、アシスタント当初から、提出物のリマインドや議事録といった、誰でもできる雑務を積極的に引き受けるようになりました。

やるべきことを着実にこなし、定例コースワークで議論して方向性を整理して、少しずつ成長されていくトレーニーの姿に喜びを感じていました。 一方で、自分が貢献できているのか、自分に何ができるのかと問い続ける日々でもあり、成果に向かって走り続けるトレーニーの姿に、嫉妬の感情が芽生え、呼吸が浅くなり、視界が白く滲むような感覚に襲われることもありました。

あるトレーニーが論文投稿を目指すことになり、共著者として参加させていただけることになったのは、貴重な機会でした。 しかし、当時の私はまだ自分で論文を書いた経験すらなく、構成や内容に踏み込んだコメントはできず、typoや言い回しの調整といった表面的な作業に終始していました。 深いレビューができない自分の無力さに、また落ち込むことになります。

それでも、誰でもできる簡単な作業を丁寧に続けていくうちに、自分には時間を惜しまず注げる資源だけはあることに気づきます。 だから私は、誰にも相談できない状況をできるだけ減らすことを内なる目標に、「いつでもご相談ください」と常にオープンに構えるようにしていました。そして、相談を持ちかけてくれた暁には、「人に相談するのも悪くないな」と思ってもらえるようなフィードバックを意識していました。

ありがたいことに、壁打ちやレビューの依頼をしてくれるトレーニーがいらっしゃいました。 何度もトレーニーと議論に参加するうちに、少しずつ自分なりに感じたことや意見をコメントできるようになりました。 特に、トレーニーには向日性の魅力があり、相談の場での何気ない会話が自分にとっての救いにもなっていました。

次第に、「最後まで寄り添うこと」がアシスタント1年目の内なるテーマになっていました。 たとえ自暴自棄になっても、周囲が距離を取ろうとしても、せめて自分だけは傍にいてエールを贈り続ける存在であろうとしていました。

2023年度が終わる頃に、それが本当に問われる出来事がありました。 詳細は伏せますが、あのときの体力と時間と粘り強さは、アシスタントを承諾したときの覚悟と、「最後まで寄り添う」という意識を保つことで支えられていたと感じます。

1年という期間は、長いようであっという間で、いろいろなことが起こります。 私はトレーニーの皆さんが「笑顔で成果発表会を迎えられること」を、当初からの何よりの願いとしていました。 そのために私にできることが、最後まで寄り添うことだったのだと思います。

アシスタント2年目

2023年度では、トレーニーの皆さんが笑顔で成果発表会を迎えてほしいという願いは、十分に叶ったと感じています。 私自身としてもやり切ったという手応えがありました。 他者のためにここまで夢中になって頑張れたことに、驚きすら覚えました。 人が成長していく様子は本当に尊く、そこにアシスタントとして携われたことを、心からよかったと思えていました。

だからこそ、2024年度もアシスタントを続けたいと問われると、すぐに答えが出ませんでした。 もう一度、同じ気持ちで向き合えるのかという不安があり、やるからには再びそれ相応の覚悟が必要になるとわかっていたからです。 完全燃焼した直後でうまく気持ちが入らないまま、また1年間アシスタントを担うくらいなら、「アシスタントをやりたい!」と心から思っている他の修了生に席を譲るべきではないかと考えていました。

この思いをトレーナーに伝えつつも、ありがたいことに再度お声がけをいただきまいた。 私はSecHack365というコミュニティが好きであること、そして他者とのかかわりや寄り添いの営みが、私自身の精神を支えてくれたことから、2024年度もアシスタントを引き受けることにしました。

とはいえ、2023年度にアシスタントを経験していたからといって、2年目当初からうまく立ち回れていたわけではありませんでした。 コースワークでの議論には積極的に参加できるようになったものの、年度が変わればトレーニーも一人ひとりの性質が大きく変わります。 2023年度と同じやり方ではうまくいかないことにすぐに気づかされました。

重要なのは、私が楽をすることではなく、成果を求めることでもなく、トレーニーがどうすれば笑顔で成果発表会を迎えられるかということであり、一人ひとりの背景と状態を受け止め、接し方を変えていく柔軟さが求められました。

トレーニーの中には、私のようにSecHack365で初めて研究に挑戦する人もいます。 過去の自分と重なるような姿に触れるたびに、私が果たすべき役割は何なのかという問いに向き合い続けることになりました。

特に、言葉に注目するトレーニーと対話を重ねる中で、私は「自分がどんな言葉を使っているのか」に注意を向けるようになり、誰かに向ける言葉が過去の自分自身とつながっていることに気づけました。 私はかつて、自分が必要としていたような言葉を、他者に寄り添う言葉として他者に届けようとしていたのかもしれません。

決して技術的なサポートが十分にできていたとは思っていませんが、 技術では支えられない部分を、私の体験や思索の中から差し出すことはできたのではないかと思います。 それは、他者のためというよりも、自己否定に傾きやすい自分自身を護りながら誰かとつながり続けるための方法だったのかもしれません。

Absurd Meditations

本題に入ります。

この文章は、SecHack365で過ごした3年間の内省の記録を振り返り、整理したものです。 生きることの意味、不条理な現実、自分という存在への不信など、さまざまな問いを抱えながら、私がこれらの問いにどう向き合い、どこに絶望し、どこに救われたのかを、等身大のまま書き留めました。 華やかな成果ではなく、愚直な思索と葛藤の痕跡を、私自身の自省録としてここに残します。

同じような行き場のない問いや言葉にならない痛みを抱えている誰かにとって、この記録がそっと寄り添える存在になれたらと願います。

自分を乗りこなす

毎日を生きる中で、「自分」という存在が、時に手に負えないものに感じられることがあります。 理想と現実とのすれ違いに心が痛み、手放したいはずの過去に足を取られ、感情の波に揺さぶられることもあります。

自分とは、ナニモノなのでしょうか。なぜ、思うように生きることはこんなにも難しいのでしょうか。 自分をどう乗りこなしていくかという観点から、自己との向き合い方、内面で起きる葛藤、そして他者とのかかわりがもたらす救いについて探っていきます。

自己認識の歪み

私は自己肯定感が低く、常に自己否定的な感情を抱きやすい傾向があります。 このために、自分自分をまっすぐに見ることができず、他者からの言葉を素直に受けとることもできませんでした。 誰かに褒められることがあっても、失礼なことにお世辞を言われているような感覚がありました。

他者からの評価や過去の失敗、幼い頃に刷り込まれた価値観によって、自分自身の姿が歪んで映ってしまうことがあります。 歪んだ姿の自分が本当の自分だと思い込むと、つい自分に厳しくなりすぎてしまいます。

このような自己肯定感の低さが、自身の能力や自身の存在に対する価値を正しく認識することを困難にさせていきました。

日報を始めたのは昨年のSecHackの秋の集合回だと記憶しているので、今日でだいたい一年記念です。この一年でいったい僕は成長できているのだろうか、あんまり自信が持てなくてこれまでの日報を漁っていた。日報を振り返ったうえでの自己評価としては、うーん、あんまり進んでいないのでは?という感じです。MBSDのコンテストで優勝して、SecHackでしんどくなっちゃって、大学院に入ってからはその場しのぎの生活を半年間してしまっていたなぁ。どうしたら前に進んでいると思えるのだろう? 僕は優しさで取り繕った、中身は本当に冷たい人間です。近い領域に来られるととたんに冷たくあしらう振舞いをするのですが、その領域には自分が常に居るので、自分に対して異常に厳しいオタクになるのです。輝かしい人を見ていると、そうでない自分が対照的に惨めに見えてしまいがちです。おそらく自分にはまだいろんな可能性があるのだとどこか信じている自分がいて、そうはなれないのだと多方面から察してしまうたびに悩んでしまうのです。憧れの誰かになることはどう頑張ってもどう焦ってもなれないこととか、他の誰かを見ていてもしょうがないなと正しく認識することができるようになりたいな。たぶんそれが大人になることの良さだったり寂しさだったりするんだろうけど。 周りの天才たちと比べてしまう悲しきモンスターを守るための習慣化があるのかなぁと感じています。明日はどんな1日にできるかな。 また主なる神は言われた: ”人がひとりでいるのは良くない。(2023年11月18日(土)日報)

自己認識が歪むとは、自分を他者や理想の目線で見すぎてしまうことであり、そこから生まれてくるのが、「自分は恥ずかしい人間である」という感情です。

「恥ずかしい人間」と決めつけてしまう自分

自分の弱さは自覚しているものの、それを真に受け止め切れていないから、自分が「恥ずかしい人間」であると感じたり、自己否定に悩む瞬間が発生したりして、生きづらさを手放せずにいます。

自分には明確な夢や目標がなく、どうすればいいのかよくわからないまま、目の前の瞬間をどうにかやり過ごすことを続けている。そんなとき、具体的な夢や目標を掲げ、まっすぐに宣言できる人が目の前に現れると、自分の小ささや薄っぺらさが否応なく浮き彫りになる。眩しい。自分がいかに「何も持っていないか」を突きつけられるようで、思わず目を逸したくなる。漠然とした「ナニモノかになりたい」という稚拙な妄想だけが、取り残されたかのようにそこに居座っている。そして、いつまで経ってもその妄想を手放せずにいる自分が、恥ずかしくて、嫌になる。 目標や結果そのものよりも、それに向かって最後までやり遂げる根性によく嫉妬する。自分は最後まで頑張りたくても、肝心なときに踏ん張ることができない。最後まで走り切る苦しさに理解を示せるからこそ、泣きながらでも手を動かせる人を尊敬している。どんなに惨めでも、自分を褒める根拠が無くても、それでも歩み続けられる君は本当にすごい。一方で、そういう人を目の当たりにすると、羨望と同時に苦しさを覚える。どうして自分はみんなと同じように頑張れないんだろう。 実際には誰も自分を否定していないはずで、勝手に他人の目を借りて自分を裁いている状態から恥ずかしさが生まれていることはわかる。でもどうしたらいいのかわからない。本当は自分で自分を好きになってもいいはずの瞬間だってあるはずなのに、もうハードルが上がりきってスルーしてしまっている。本当は自分も何かを頑張っているはずなのに、自分はナニモノでもないということに悶々としてしまう。くだらないだろ。 妙に綺麗で 泥臭い わからない中で (2025年3月13日(木)日報)

他人が自分を見て「ダメ人間」と言ったわけではありません。 それなのに、まるで他人がそう思っているかのように感じてしまいます。

周囲の輝かしく活躍している人たちを見ると、それと対照的な自分がいかにダメな存在なのかということで思い悩んでしまいます。 その時間が長引くと何も手がつかなくなり、余計に自分はダメだと感じてしまう悪循環に陥ることがあります。

劣等感に苛まれる人生で最も無駄で苦痛な時間を過ごしていた。全身がナメクジになっているのでさっさと寝ます。(2023年7月25日(火)日報)

理想と現実とのギャップ、過去への執着、感情の波に日々振り回されますが、これらすべてを咎めているのは、他人ではなく「自分」なんですよね。 なのでここで言う「恥ずかしさ」とは、 “他人の目を借りて、自分を裁いている状態”なんだと思います。

でもここで自分に提案してあげたいのは、自分を「正しく評価しなおす」ことではなく、「乗りこなす」ということです。 つまり、自分の感情や過去の思い込みが、いまどんな動きをしているのかを観察し、自分の取り扱い方を学ぶという姿勢です。 そして、観察の視野を広げ、硬直した自己観察から解放してくれるのが、他者の存在になります。

他者の存在

「すべての悩みは対人関係の悩みである」という考え方もありますが、救ってくれるのも人しかいないんですよね。

独りでいると、自分の思考の同じ面ばかりを眺め続け、視野がどんどん狭まってしまうものです。 しかし、他者と交わす何気ない会話や、相手の表情・声に触れるたびに、自分の内側にこびりついた思い込みや過去の傷が、他者との対話の中でそっと剥がれ落ちることがあります。

僕はいろいろなものを拗らせてしまった過去があるので,楽しいなんて怠慢だという考えが残っていてしまっている.そのせいで本来楽しむべきところを楽しもうとしなかったり,常により苦しい選択をすることこそが幸せなんだみたいな考えが植わってしまっていた.ストイックにがむしゃらに何かをするのを数年間続けていると,人よりコストをかけている分当然成果は出やすくなる.運もあったお陰でいくつか手に入れることができたものもあったけど,その一方で失ってしまったようなものもたくさんあって,それはむしろ後者のほうが圧倒的に多い気もする. しかしどうだろう.何事にも挑戦し続けるためには精神的な健康が必要であることは昨年よくわかった.他愛のない話が自分を救ってくれたり周りの明るさに照らされたり,助けてもらってばかりだ.未来の理想化された自分を追いかけて,今の自分を蔑ろにして今のこの一瞬を楽しめずにいた.凝り固まった自分の思考に気づきを与えてくれるのは何気ない他者との会話だったりする.安易にすべてを打ち明けられるほど僕は強くはないけれど,近視眼に囚われている自分を紐解いてくれるのは自分以外の他者なのかもしれない.(2023年8月9日(水)日報)

他者と関わることで、自分が何に縛られていたのか、どんな価値観に従って自分を苦しめていたのかが浮かび上がってきます。 独りで内省しているときには決して気づけなかった"当たり前"や「こうでなければならない」といった思い込みが、他者との対話の中で綻び始めることがあります。

今週の僕は人に相談したり人をご飯に誘ったりしています。助けて欲しいサインは出すけど迷惑かなと思っちゃったりしてなかなか自分から言い出すことのできない僕にとって革命的な行動を取っています。さっそく上司が1on1をしてくれました。 「いろいろ悩みがあるが、たいていのことは僕がもっと強くなれば解決することだらけなんよな」とずっと考えていたけど上司に「それはやめた方がいい」とズバッと言われました。伸ばしすぎた理想と現実の僕とのギャップがあるせいでそこに辿り着くことができないと不必要に苦しめてしまうんだよな。”こんなこと”もできないのかと。 性格をアップデートしていくのはなかなか時間のかかる作業です。久しぶりにまぁ全体的にはいい方向には軌道修正できているかと認知できたのはよかった。誰かに認めてもらえるようなことは別に必要ないので、周りの人が手を差し伸べたくなるような人になりたいな。(2023年7月20日(木)日報)

そして、誰かに本音を伝えられて、受け入れてもらえたときには大きな安心が芽生えます。 その安心が、自分の弱さや過去の傷をも否定せず、ありのままに抱えて生きていくための力になります。

だから、他者と関わることは怖いことのようでいて、実はとても人間的で、あたたかい営みです。 うまく言葉にできない気持ちを誰かが拾ってくれたり、予期せぬ一言にふっと心が軽くなったりするような、ささやかな体験の積み重ねが、自分のことを少しずつ、確実に優しく解きほぐしてくれるように感じます。

俗世との接点

社会が提示してくる幸せの型や成功の基準を自分に重ね合わせた時、そこに馴染めていないことを感じると、不安に思ったり、自分だけ遅れているように感じたりします。 直接的に自分の持っているものを否定しているわけではないのに、目の前に広がる他者の世界が眩しすぎて、自分の場所が霞んで見えてしまうような、そんな切なさが"生きづらさ"をもたらします。 そして、その痛みから身を守ろうとして、つい人とのかかわりを避けたくなってしまうものです。

なんか世の中もっともっと俗ぽくて、毎日ひたすら死に物狂いで技術を学んでいるのはかなり異質みたい。多くの人にとって勉強は単位を取るためのものとしか考えてないみたい。能動的な趣味を持っていて、アルバイトをして、居酒屋に行って、友達と旅行して、恋人がいて、幸せそう。歳を重ねて学年が上がっていくにつれていつのまにか社会的な価値が存在していることに気づいて、それを選べてない自分が不正解みたいで、学歴とか、就職とか、結婚とか、収入とか、好きなものとか、自分が急に遅れているように感じる。(2022年5月28日(土)日報)

でも、俗世との接点そのものが悪いわけではなく、むしろ俗世にこそ、自分とはナニモノであるのかを知るきっかけや、ふとした瞬間に自分を優しく肯定してくれるような温もりが確かに存在します。

重要なのは、幸せの型に自分を無理に合わせようとすることなのではなく、俗世との接点の中で、自分はどう感じるのかを丁寧に見つめることに他なりません。 一つひとつの出来事の感触を手掛かりに、自分らしさを見出す余地があるのなら、俗世との接点は悪くはないと感じられるものです。

神戸に住んでいたころの行きつけのクラフトビール屋さんに久しぶりに足を運んだら、門出を祝ってくれました。PARKARのボールペンを用意してくれていて、次にお店来たときに渡そうと準備してくれていたようです。PARKARの矢羽は、新天地に向けた応援の証らしいです。プレゼントの物自体ありがたいと思いつつ、何よりも僕の門出を想いながら、心を込めて選んでくれたそのお気持ちが尊いなと感じます。自分が他者の人生の中に確かに存在しているんだと思えた。(2025年4月5日(土)日報)

俗世というのはざわざわした場所でもありますが、日々の出来事の中に人と人の関係の温もりが確実に存在します。 俗世との接点を適切に持てた時、そこで初めて「自分が存在していいんだ」と実感できるようになります。 それは、誰かに承認されるからというよりも、他者と関わる中で、存在すること自体が関係を生み出していることに気づくからです。

自分が大切にされた記憶は、これからの歩みにそっと寄り添ってくれるはずです。 どこかに自信を持てなくなっている自分がいたとしても、過去確かに迎え入れられた瞬間があったことを、忘れないようにしたいです。

自分の中にある答えを引き出す

人は、意外と自分自身の中に答えを持っているものであったりします。 ただ、独りではそれを引き出すことが難しく、誰かに引き出してもらうことで、整理するきっかけを与えてもらう必要があります。 その相手は、特に助けようとはせず、ただ聞いてくれる存在であることが多いと感じます。

人が心の奥底で求めているのは、優れたアドバイスや明快な回答よりも、まずは「ここに居てもいい」と実感できることなのかもしれません。 「わかってもらえた」という結果よりも、「わかろうとしてくれている」という過程に"救い"の種があるように感じます。

他者を救おうとすることは一見崇高な行為に思えるが、自分の期待を相手に押し付けることになってしまう場合もある。そして、それは自分の自由を制限するだけでなく、相手の自由をも奪うリスクがあるのかもしれないのだ。相手は救うつもりがないのに、話を聞いてもらった結果、自分が救われたと感じるというのは本当に不思議なことである。相手が存在そのもの、つまりただそこに居て、ただ話を聞いてくれることそのものが救いのような力を持っている。無条件の肯定的関心を他者に示せるよう、自分も根本的な姿勢や意識の持ち方を変えていきたい。(2024年12月3日(火)日報)

私もまた誰かにとって、ただ傍にいる存在であれたらと思います。 無理に導こうとせず、評価もせず、ただ「あなたがいてくれることが大切なんだよ」と態度で伝えられるような存在になりたいです。

自分に赦しを向ける

自分を厳しくしてしまう背景には、「もっとできるはずだった」「本当はこうありたかった」という強い願いが脳に焼き付いていることにあります。 そして、過去の選択や失敗した出来事を、今の自分の目線で裁いてしまい、"あの頃"の自分を「恥ずかしい人間」であると心から軽蔑してしまいます。

過去の未熟さを経験として受け入れたり、自分の中で折り合いをつけたりして、「そういうこともあったな」と流せる人もいるかと思いますが、未だに私は過去に執着してしまいます。 いろいろな出来事を経験して、もう姿や考え方は変わっているというのに、”あの頃”の未熟な自分が"本来の自分"として思えてしまうから、手を止めた瞬間にまた”あの頃”に戻ってしまうのではないかと自分を赦せずにいました。

僕はセンスや才能なんて無いのでやったことないことはうまくいかないし、目標が無いと何していいのかよくわからなくなる。自由な時間が与えられると逆にうまく動けなくなる自覚がある。人の目ばかりを気にしちゃって、自分の好きなものさえもよくわからなくなってしまう。馬鹿にされるのが怖いんだ。 根本の人格を矯正することは時間もかかるし意識的な矯正は苦しい時間が続く。最近何度も書いているけど、こんな自分であることを受け入れてそのうえでどうするか考えるほうがまだ楽だ。それでも苦しい状態をデフォルトに選ぶことになってしまうかもしれないけど、うまく目標づくりをHackして毎日を歩んで生きたい。あとは、僕が僕自身を赦せるかどうか。 (2024年6月10日(月)日報)

でも、本当に大切なのは、「あのときの自分にとって、できる限りの選択をしていた」という事実を認めてあげることです。 それがどれだけ拙く見える選択も、選ぶことすら叶わなかった選択も、その瞬間の精一杯でした。 そして、そこを通らなければ今の自分には辿り着けなかったということも、確かな事実です。

赦しとは、忘れることでも正当化することでもなく、ただ、"あの頃"の出来事や感情に対して「もう責任を感じなくていい」と自分に言い聞かせることです。 このためには、自分の中にある痛みや後悔、恥ずかしさや怒りに対して、「そう感じていた自分がいた」こととして認めてあげる必要があります。 おそらくこれに気づいてあげることでしか、手放す準備はできません。 むしろ、感じることを避けて抑圧するほど、感情は内側に留まり続けます。

あとは自分を赦すことができるかどうか、というところまで来ているような気がするけど、それがもう本当に難しい。自分の弱さは自覚しているものの、それを真に受け止めきれていないから、自分が恥ずかしい人間であると感じたり、自己否定に悩む瞬間が発生して、生きづらさを手放せずにいる。あの頃の自分はどうしようもなかったんだと、自分を慰めたくてそのままの自分でいることを選んでしまいがちだけど、もう幸せになろうとしていいはずなんだよな。 現在の自分と過去の自分はもう姿も考え方も別人なんだから、責任を感じる必要はないはずなんだ。責任を感じないということは、過去を無かったことにしているのではなく、過去を受け入れた上で、今を生きるための自由を得ることになる。その自由を得るには、少しずつ自分を赦していく習慣が必要だ。(2024年11月19日(火)日報)

そして、赦しは他者との関係の中でも育まれます。 誰かの優しさや共感に触れることで、自分を少しずつ見なおすきっかけにもなれます。 自分を赦す行為は、決して孤独な作業ではなく、他者との間で少しずつ温めながら行うものでもあります。

臆病さの受容

私の性格を一言で言うとすれば、臆病です。 いつも不安がったり、慎重になりすぎたり、「自分なんて」と思ってしまったり、人の顔色を伺ってしまったり、完璧を求めてしまったりして、繊細な感情に振り回されてしまいます。

でも、臆病さが教えてくれる自分なりの戦い方は存在します。 臆病を欠点として克服しようとするのではなく、性質として引き受けることで、自分に合った立ち回り方が見えてくるようになりました。 徹底的な準備や事前のシミュレーション、細部まで目を配ることなどはまさしく、臆病さがあるからこそ取れるアプローチです。

どこまで行っても、どうあがいても、自分以外の誰にもなれないだよな。そんなことは疾うに気づいている。はじめから答えは出ていたんだ、目の前のことを誠実に向き合うことが僕のやることのすべてなんだ。 課題を不明確にしたまま、漠然とした不安に駆られ続けるのにはもう飽きた。自信満々で楽しんでいる人が魅力的に見えるのは知ってる。結局僕は臆病な僕にしかなれないんだ。でも、だからこそ、こんな自分だからここまで来れたって思えるようになりたいな。(2024年5月18日(土)日報)

私は、何かを選択することもあまり得意ではありません。 選択という行為が重く、未来に対し責任を感じて強い不安に駆られます。 でもこれは、自分の人生をちゃんと自分で引き受けたいという願いの裏返しなのかもしれません。

納得のいく選択とは何なのだろうか。自分の選択に関して、自身が合理的に考えてしまうのであれば何かしらの理由付けが必要である。どうしてその選択に至ったのか点と点が離れていると後悔してしまいそうな気がしてならない。Connecting the dots の話的には、後になって本人だけが点と点を繋ぐことしかできないということで、その話には同意するけど、何か決断をするときその時点では、手元にあるカードでどう点を繋いで合理的に見える判断ができるかがポイントになる。もちろん、大事なのは選択した道を正解にすることであって、選択や決断を嘆くことじゃない。だから決断の時点で繋いだ線は少し先に進むと、より線を結ぶのにしっくりくる別の点が見つかったりすることもある。 ある地点における決断というのは、逡巡をまた一つ辿るということになる。つまり決断という行為そのものが新たな迷いや逡巡を引き起こす。せめて最大限意識的で論理的な判断するために、何かを選択するにしても何かを選択しないにしても、理由をちゃんと見出して、言語化して記録しておくことが大事なのであろう。選択で人間が表現されていくのを感じる。(2024年5月28日(火)日報)

選択も、無理に自信満々である必要はなく、その地点で自分ができる限りの準備をすることがまずは大事です。 選択から生まれる迷いに固執するのではなく、選択を通じて自分が何を大切にしようとしたのかを見つめることが重要です。

臆病さと向き合いながら、その時々で出せる精一杯の選択を積み重ねていくことが、自分の人生を生きるということになるのかなと思います。

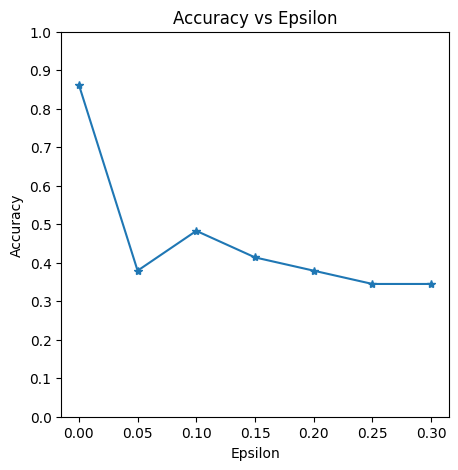

探索的な仮説検証

環境が目まぐるしく変化し、不確実性の高い今の時代では、PDCA(plan-do-check-act)サイクルを回そうとしても、適切な計画を立てること自体が難しくなっています。 だからこそ、仮説を立てて、実際にやってみながら学んでいくOODA(observe, orient, decide, act)ループ的なアプローチのほうが肌に合っているように感じます。 臆病さによって根拠のない楽観を疑ってしまう性質を利用すれば、大きなリスクを負う前に検証することで正しく怯える準備ができるようになります。

行動の中でしか見えないものを手に入れるには、完璧な安心が揃うのを待っていても何も始まりません。 でも、自分の人生を"仮説"として捉えると、少しだけ自由になれる気がします。 「これをしたらどうなるかな」という実験的な姿勢は、正解主義からの脱却になります。 これにより失敗もまた、1つの"実験結果"になり、生きるという行為に靭やかさが宿ります。

今日は思いがけないタイミングで進路の相談をさせてもらえる機会があった.僕が研究がまだまだ下手で,ちょっと変に苦しんでしまうタイプだというのはよくわかった.なんとなく自分ではそう感じているんだけど,言葉で言われて頭で理解していても,本当の意味で理解できていないというか,自分がそうじゃないんだよなぁと思いつつも”そうじゃない”選択や行動を取ってしまう.これを修正できるのはやはり経験.わからないからこそ,やったことのないことにチャレンジして経験してみることが重要なんだよな.おそらく,わかってみれば大したことはないはず.あとはもっと肩の力を抜いて,楽しんでいかないとなと思った.(2023年8月22日(火)日報)

変わり続ける勇気

臆病だからこそ、変化は怖いものです。 変わるということは、今までの自分の一部を手放すようなものなので、頭では分かっていても心が追いつかず変化を恐れている自分がいます。

でも、変化や選択を求められる瞬間は、いつだって容赦なく訪れます。 このときに恐れを押し殺して突き進むのではなく、恐れに押し潰されて立ち止まるのではなく、恐れとともに歩む選択肢があることを忘れないようにしたいです。 今の自分に丁寧に向き合い、まだ出会っていない自分の可能性に少しだけ耳を傾け、歩み続ける勇気を持てるようになりたいです。

そして、変わるということは、何かを成し遂げるための目的ではなく、日々のプロセスそのものです。 何かが急激に変わるわけではなく、小さな選択の積み重ねの先に、気づけば景色が違って見えるような緩やかな遷移です。 だからこそ、自分を乗りこなすということは、変化することを目指すのではなく、変わり続ける勇気を持ち続けることに他なりません。

豊かさの中に生まれる空虚感

空虚感は捉えどころがなく、手応えのない感情です。 何もないというより、何かあっても、それに意味があるとは感じられないという感覚にあります。

何かが足りない・満たされないという漠然とした思いは、いったいどこから来るのでしょうか。 なぜ満たされるほどに、満たされなさが際立ってしまうのでしょうか。

この問題は、物質で満たされるものではないし、承認や賞賛でも補いきれません。 存在と世界とのつながり、つまり「生きていて意味がある」と感じられるような瞬間や関係性の中にしか、満たされる感覚は生まれないのかもしれません。

豊かさという枠組みの中に、逆説的に存在の置き去りがありました。

身内が結婚しようが,研究で打ちひしがれようが,仕事で疲弊しようが,誰かに手を差し伸べようが,俺の人生やこの世界は一切変わらない.俺が何かしたって何も世界は変わっていかないのに,どうして苦しい中生きる必要があるというのだろう.あらゆる感情の先に諦めが来ていて,この世の中のすべてが無意味に思えてくる.何もカッコつけたい意図はなく,自分の存在自体が無力なんだから,あらゆることにそんなことをしても意味が無いじゃないかと純粋な眼差しで捉えてしまう.何も感情が湧いてこないくせに,不安に代表される辛い感情だけは一丁前に感じる.ひたすら毎日何かに追われ,衣食住も満たされているはずだが,空虚感だけが漂っている.この手ごたえの無さはなんだんだ. 実家に帰って親に会ってみると,親は今日の出来事を楽しそうに話す.それが不思議でならなくて,適当な相槌をしてしまう.一日の出来事のうち,ネタにできそうなことであればメモを取るようになったが,別に話す必要のないことだと切り捨てるものがほとんどである.すべてが無意味だと思うと,こちらから話すことは本当に無い.空虚感とは無縁に思える人たちがいるのが不思議に感じるのだ. 一度覗き込んでしまった実存的な問題を見なかったことにして,無視することはできない.だから,「考えすぎだよ」という意見を受け入れることは難しい.休養や対症療法では何も改善しないことは察せてきた.空虚感の問題を真に解決するには,やはりこの問題にしっかりと向き合って空虚感の正体を突き止めることしかないのかもしれない.生きるなら,その選択肢しか残っていないんだ.苦しいなぁ.この苦しみの課題に,どう運命を見出せばいいんだろう.(2024年7月14日(日)日報)

不幸せの原因

自分はなぜ不幸を感じるのでしょうか。

その問いに向き合うときに、私の内側には、いくつかの根深い感情や思考の癖が浮かび上がります。 それらは単に一時的な気分の問題ではなく、私の生き方や感じ方に長く影を落としてきたものです。

ここでは、自分が感じてしまう不幸の背景にある要因を整理して、それぞれがどのように心を蝕むのかを見つめなおしてみます。

他者との比較による相対的な不足感

私は、社会の中で自分の位置を把握するとき、どうしても他人と比べるという基準を使ってしまいます。

自分の存在価値が他人に依存すると、「他の人はできていて、自分はできていない」というような苦しみが与えれます。 特に現代では、SNSによって他者のハイライトが視界に飛び込んでくるので、比較がより過酷で、過剰になります。 しかもその比較は無限に続き、どこまで行っても満たされないという構造を生んでしまいます。

最近はよく大学の喫煙所で休憩しています。風当りがよくて、いい感じに腰を掛けられるところがあって、ぽかぽかした日陰で、一人でぼーっとエナドリ片手にツイッターとインスタを眺めてみんな楽しそうだなと空しくインターネット越しに傍観するのは悪くない。副流煙はあまり吸いたくないので誰かが来たら休憩を終えて研究室に戻るようにしているけど、タバコを吸いに来るおじさんたちは大抵この世界に絶望したような疲れ切った表情をしていてとてもいい。タバコは周りへの影響がデカすぎるから(人に迷惑かけることだけはしたくないので)吸わないようにしているけど自分みたいな人間は一度覚えてしまうともう抜け出せない気がするので手を出さないように耐えてる。心の拠り所としてこれをしたら確実に落ち着くというものがあるのは正直羨ましく思っています。(2023年8月7日(月)日報)

自己否定的な感情に根差した内面的な満たされなさ

満たされなさは、外的な欠乏というより、むしろ内的な構造に根差した感覚です。 満たされたいと願っているのは自分自身のはずなのに、その自分を信じることができず、自分の価値を感じられない状態に陥っています。

何をしても意味がないという無力感と同時に、自分には何かを為す価値があるはずだと願う声も、裏腹に存在しています。

自己否定が心の奥深くに根を張ると、自分の価値を受け取る器そのものが傷ついてしまいます。 何かを成し遂げても、誰かに褒められても、それが自分の中に真っ直ぐ届かず、まるで心の箱に小さな穴が開いていて受け取ったものがそのまま漏れていくような感覚に襲われます。

自嘲的なユーモア

自嘲とは、自己を笑いの対象とすることです。 これは一見、他人の嘲りを先回りして引き受ける軽やかな振舞いですが、ここで起こる笑いには自己否定という棘を含み、無意識のうちに自分の存在価値を削っていくことにもつながりかねません。

ピエロになったつもりで自嘲していても、実はユーモアで包まれた仮面の中には本音としての痛みが含まれています。 深刻になり過ぎたら壊れてしまうから、ふざけた表現で傷の輪郭を曖昧にして、痛みの核心に触れないように笑いで蓋をするこの行為は、他者との共有を装い孤独を際立たせる自己表現です。

誰かに笑ってもらえたとしても、まったく癒されないというのに、そうでもしなければ耐えられない瞬間があって、そのときに選ばれた言葉や態度が、たまたまユーモアだったというのが、自嘲の始まりなのかもしれません。

お前今日何したんだよ。俺はよ、高校時代仲良くしてた昨年入籍したあのどうしようもない人間だったはずの同級生がよ、インスタで赤ちゃん生まれました投稿していて心がぽっかりと空いてしまってよ、相変わらずおめでとう以上に謎の衝撃が来ているんだ。絵文字使っているところなんか見たことないのにその投稿には :angel: :baby_bottle: :sunny: :hatching_chick: が使われててよ、なんだなんだと動揺している自分が居るんだ。でも逆に良かったと思ってる。こうしてまた日記でネタにできるからな。 そんな俺はよ、お金に興味ないくせに働いてばっかりだ。給料が振り込まれても、真顔だ。特に欲しい物もないし外食もしないからよ、扶養を超えて稼いでいるのに貯金が溜まる一方だ。 俺はバレンタインだっつって買ったイチゴの板チョコを貪りながら、今日もパソコンの前に鎮座している。お前らが俺のことを感情の無いモンスターと呼ぶからだぞ。アイツには最高なプレゼントを贈ってやろうと思ってる。お前の人生の進捗はどうだ?毎日辛いけど俺も頑張るからよ、お前らも頑張れよ。(2024年2月15日(木)日報)

また、自嘲は助けを求める機会を奪ってしまいます。 深刻さを笑いに変えることで、自ら真剣に扱ってもらう権利を放棄してしまいます。

たとえ笑いという形式であっても、繰り返された言葉には力があります。 ユーモアの名のもとに、自己否定を何度も反復するうちに、心の奥にある自尊心が静かに削がれていきます。

お前今日何したんだよ。俺はよ、高校時代仲良くしてた、昨年度入籍・出産したあのどうしようもない人間だったはずの同級生がよ、インスタでマイホーム建てたとの投稿をしていて相変わらずおめでとう以上に謎の衝撃が来ているんだ。立派すぎる新築と家族3人での温かい写真に幸せが溢れていて目が眩んだんだ。 片や俺は1Kの賃貸で今日も1人胡坐をかきながらこの話をまたネタにしようとウッキウキでこの日記を書いている。スマホの写真アルバムを見返せば、ご飯や風景の写真ばかりで、人間が映っている写真は少ない。内カメで写真を撮る機会が少なすぎるからだ。 どうしようもない人間だと決めつけていたはずの彼は、齢25にして家族だけでなく遂にマイホームを持つようになってわかりやすく立派だ。自分が取り残されているかのように感じるが仕方ないだろこんな生き方しかできないんだから、という風な流れでこの日記をニヤニヤしながら書いていたが、いつまで俺は俺を虐して、まるで悲劇の主人公であるかのように被害者ぶる振る舞いを続けているんだ? 結局俺は、自分を恥ずかしい人間なんだと決めつけて、すべてを諦めることであの頃の俺はしょうがなかったんだと自分を慰められる落としどころとして選んでしまいがちだけど、もう幸せになろうとしていいはずなんだよな。お前の人生の進捗はどうだ?インターネットのお陰で俺たちは離れていても繋がっていられるからよ、俺も頑張るからお前らも安心して頑張れよ。(2024年6月11日(火)日報)

自身の存在意義や将来への漠然とした不安

存在意義は、厄介な存在です。

「人生には明確な目標が必要だ」「ナニモノかになれなければならない」という社会的な語りの下では、明確なビジョンを描けていないという状態自体が、まるで失敗や怠慢のように感じられてしまいます。

また、社会の中で求められる“役割”や“成果”という基準が、いつの間にか自分の存在価値の物差しになってしまい、"ナニモノでもない自分"に対する焦燥感や無力感を育ててしまいます。 その結果、自分の人生に意味があるのかどうか、自分という存在がどこに位置づけられているのかがわからなくなっていきます。

自分自身の存在の意味や将来の展望を持てないことが、そのまま存在の否定に結びついてしまうと、自分の足元を見失ってしまいます。 どこにも向かえていないという感覚が、自分の現在を空虚にし、未来を重く不透明なものにしてしまいます。

いろんな選択肢や可能性があるように見えて,悩めば悩むほど自分のしたいことがよくわからなくなって,どれもがぼやけて見える.僕は技術や研究が好きだと大きな声で言えないし,流れの激しい戦場で戦って生きていくことはもう辛い.不器用だからやったことないことは大抵うまくいかないし,何かを選択するということ自体が怖い.何をするにも怖くて,今何をしたいのかよくわからず未来を想像できずに時間だけが過ぎて,八方塞がりになっている自分が不正解みたいで社会に取り残されていく感覚がある.そんなことはないらしいんだけどさ.(2024年4月25日(木)日報)

人生の勢いと強迫観念

本来、努力は前に進むための行為のはずなのに、その動機が「自分には何もないから」となった時点で、その努力には終わりも安心も無くなってしまいます。 しかもその強迫観念は、自分自身の声で繰り返され、次第に「走ることでしか自分の存在価値を証明できない」状態になっていってしまいます。

気づけば、私は立ち止まることに罪悪感を覚えるようになりました。 だから、人生の勢いに任せることで思考を凍らせてきたのかもしれません。

強迫観念も、本来は自分自身への要求のつもりでした。 「お前はナニモノにもなれていない」といった声は、確かに自分の中から生まれたものであり、一見すると自律的な内省のように思えます。

しかし実際には、その声の語り口は、他者や社会から無意識に受け取った価値観に根差しています。 つまり、自分に向けているようでいて、その実態は他者の視線を内面化したものであり、他者と比較した自分を裁くものです。

このとき、脅迫観念は、自己との対話ではなく、他人の尺度を借りた自分への攻撃とすり替わっています。

そして、この相対的な視座が、劣等感を生み出します。 自己に向けた要求が、他者との比較によって価値を測るようになったとき、強迫観念が劣等感に変わります。

人生の勢いを失うこと、飢えることが減ったような、脅迫観念が薄れたようなことというのは、当事者からすると苦しみから少しは解放されているのでこの変化に対してまず一つ喜びたい事象ではある。幸せを不幸な状態でないことと定義するならば、このような状態も一つの幸せと見なせるかもしれない。 だが勢いが衰えていくことが、自分をうまく乗りこなしていると言えるかは別問題である。単に心の痛覚が麻痺してしまっていることをいわゆる成長や成熟と表現してしまっている気がする。これはある意味で自分を欺いている可能性もある。要は一時的にストレスを感じにくくする防衛機制が発達したようなもので、自分はどこまで今ある感情や状況を正面から理解して受け入れようとしているのだろうか。 心の痛覚の麻痺が無いままに人生の勢いを保つことは、正直あまり想像できない。自身の変化をどう評価するかは、自分自身との対話にかかっているのだろうか。まぁ今の僕は、物憂げな梅雨の雨に打たれながら今日もダメな1日だったとトボトボと俯いて帰るくらいがちょうどいい。(2024年7月10日(水)日報)

劣等感の先鋭化

自分と他者を比べると、どうしても自分に足りない部分にばかり目につき、結果として自分自身に厳しくなってしまいます。 また、どこかで他者より優れていたいという願望が意識的・無意識的に働いている場合もあります。

自分に自信が持てず、自己肯定感が低いからこそ、他者の粗を探し、他者と比べることで自分に特異な優越性を求める防衛的な心理が働いていました。 本当に最低ですが、自分が無価値な存在であると悟ってしまうのが怖いのです。

しかし、こうした過剰な比較は逆効果で、理想と現実とのギャップを強調してしまい、結果として劣等感が強まってしまいます 。 人生の勢いがあったうちは劣等感を原動力に焦りや義務感で走ることができていたように見えますが、それは貯金の前借りのようなものでした。 ずっと続くことはなく、ふと立ち止まったときに心が空っぽであることに気づきます。

勢いに頼った生き方は、自分の内なる声を無視した生き方でもあります。 だからある日、自分を破壊してしまうような疲労感や虚無感にぶつかってしまいます。

ずっと自分を後回しにしてきてしまったから、自分を大事にするということに対して、どこかで甘えなんじゃないかというような拭い切れない葛藤が生まれてしまいます。 これはまさしく、「走ることでしか自分の存在価値を証明できない」からぶつかった壁だと思います。

この問題の根本には、「成功していたら、」「誰かより優れていたら、」というような条件付きの自己肯定があり、この小さな枠組みの中に、自分を閉じ込めてしまっていました。

今日はやけに群青が響いてぼーっとしてた。 怖いものはやっぱり怖いよ。いくらコンピュータ技術は信じたいといっても、バケモンばかりがいるこの世界で流れの激しい戦場で戦って生き続けることが自分にとっていい未来なのかよくわからなくなってしまった。しかし今の自分に無理のない選択を取ることはそれはそれで勇気が無くて難しい。もうネガティブな感情を原動力に頑張ることは卒業したいんだよな。(2023年7月31日(月)日報)

コペルニクス的転回

私はこれまで自分の不幸や失敗に固執して、その原因を突き詰めようと自分がいかに不幸であるのかと理論武装してきました。 過去の自分を救いたいというような慈しみの気持ちが、深いところで息をしていたからだと思います。 自己過剰観察により、不幸の意味や理由を求めることで、"あの頃"の痛みが報われて欲しかったり、今の自分の苦しさに正当性を与えようとしたりしていました。 しかしそこに拘っても救いは生まれませんし、かえって自分を縛っていたと感じます。

不幸を語るということは、自分を理解する手がかりになる一方で、"居場所"にもなり得ます。 これが続くと、いつしかその痛み自体が自分のアイデンティティの一部になってしまいます。

自分がいかにダメかを説明できる理由が過去にあったとしても、そこに留まり続ける限り、変われないままです。 私に必要だったものは、不幸を手放そうとする発想でした。

本当に自分を癒してくれるのは、不幸の外側にある今この瞬間の心の在り方にあると感じます。 過去は変えられないかもしれませんが、私を変えられるのは今この瞬間だけです。 今この瞬間の自分にできることをすることだけが、絶望の中に差し込む最も確かな希望になるのだと思います。

未来の明るさは異常

生きているとつい、未来には何にも期待できないと思い込んでしまう瞬間があり、そこで生きる意味や希望を見出そうとしても「だからと言ってさぁ」とすべてが無意味に思えて絶望してしまうこともありますが、だからと言ってなんですよね。

実際には、社会は善意や思いやり、小さな優しさで支えられている側面も確かにあって、人知れず行われている温かい出来事や、誰かが誰かのために尽くしている日常がたくさん積み重なっています。

未来は、不確かで予測できないものですが、今この瞬間に感じられる温かさや喜びは、確かな現実として存在しています。 心のどこかで生きててよかったと思える瞬間が訪れるかもしれないという可能性を信じていたいです。

極めて個人的な決着

結局のところの私がやるべきことを並べます。

- 目の前の小さな幸せや優しさを大切にして、今できることに焦点を当てること

- 過去に固執せずに、経験として受け止めながら、無理なく生きる意思を保ち続けること

- 信頼できる人たちとの関係を大切にして、内省や対話を通じて自分の問いに向き合い続けること

これらは誰にも共感されないかもしれない問いかもしれませんが、私にとっては切実で、本気で向き合っているものであるので、これらは乗り越えるに値する問いであり、生きるに値する問いです。

不条理の先にあるもの、残酷さへの向き合い方

この世界は時に残酷で、苦しいニュースや悪意に満ちた出来事で溢れていて、どうしようもないと感じることがあります。 そんな中であらゆることに「意味がない」と感じてしまうのは、ある意味当然の感覚です。

抗えない現実や、理解不能な出来事に直面したときに、何を拠り所にすればよいのでしょうか。 不条理に対する向き合い方やそこに潜む救いについて、今の自分なりの答えを綴ってみたいと思います。

意味を求めることの虚無感

自分の生を単なる時間の連なりではなく、「意味あるものとして生きたい」と、どこかで強く願う一方で、現実は思い通りにいかないし、むしろ意味なんてないと突き付けてくるようなことはたくさんあります。

そんな苦しい世界でなぜ生きていく必要があるのでしょうか。

この生きる意味を求めれば求めるほど、虚無感に襲われ、見つからないということに絶望する感覚があります。 逆に、意味を全く求めなければ、今度は生きているという実感さえもぼやけてしまいます。 このどちらにでも寄り切れない不安定さに苦しめられます。

人生の先輩方はよく、サイコロを振って出た目を受け入れることについて語ってくれる。これは、サイコロの出た目を正解にする努力の話で、荒波に飲まれながらもなんとか溺れないようにするアドバイスである。なぜこのようなアドバイスばかりであるかと言えば、どの目が出ても結局のところ荒波が待ち受けているからである。サイコロを振る前の時点では、どの目がよさそうであるか、どの目が出るであろうかを吟味してもあまり意味がないことを知っているからである。会社に入っても希望する仕事ができるとは限らなくて、良き上司に巡り合うとは限らなくて、何もわからないまま社会の荒波に放り出され続けることを伝えられても、はっきり言って、僕はそんな不条理に満ちた社会に希望は持てないよ。海の底に沈んだ微かな希望でいいから、それでも生きていくことの絶対的な良さを教えて欲しい。わかりやすい絶望を突きつけられても、サイコロを振るという行為が怖くなるだけだよ。 思えば人生で選べることってほとんどなかったよな。その時の環境や状況、人間関係によって決まっていくものがほとんどで、どうにもならなかった。自分の人格すらも、選択したのではなく、環境により与えられたものとして形成されていったような気がする。 人生の中で選べることってほとんどなかったけど、その中でも選べたことは時々あるはずなんだ。小さな選択でも選べることがあるということを信じないといけない。サイコロを振ることしかできないし、サイコロの出目はすべて荒波と既に決まっているのかもしれない。けれど、サイコロを振るという行為、それだけは自分で選択できる。そう思いたい。(2024年11月4日(月)日報)

合理性を越えた価値を探す

生きているこの世界そのものに客観的な意味が存在しないという現実に直面すると、自分が無力に思えてしまいます。 しかし、この虚無感は同時に、私が意味のある生を送りたいと願うものでもあります。 世界に内在する無意味さと人生が意味を求める欲望が衝突することで、不条理が生まれます。

合理性だけで世界を捉えると、生きる理由を見出すことは困難です。

究極の問いとして「自殺するべきか否か」が浮かぶこともありますが、自殺は不条理に対する1つの解決策であり、推論の末に合理的な結論として見えてしまうことも事実です。 極限まで追い込まれた人にとっては、自殺が唯一の合理的な選択肢になり得るのも十分に理解できます。 そのような状況にある人に「生きていてほしい」とただ伝えることは、相手の苦しみを軽視しているかのように感じられるかもしれません。 生に意味があるのかという問いに対して、すぐに明確な答えが出るわけではなく、言葉だけで救えるものでもありません。

一方で、人生のすべてを合理的に説明することはできないこともまた事実です。 不条理な世界の中で、合理的な結論では得られないような、小さな喜びや感動、他者とのかかわりの中で生まれてくる価値もきっとあるはずです。

漠然とした"世界"を相手にしたところで、こちらがいくら願っても思うようには変わってくれません。 意味のある人生や絶対的な希望は、どこか遠くにあるので、探そうとしたところで見つからないという現実に絶望してしまいます。 でも、日常を彩る些細な喜びに目を向けて、自分がしたことで目の前の誰かが笑ってくれたり、自分の存在が誰かの心を少しだけ軽くしたりするような出来事が、自分の人生に確かな意味をもたらしてくれるのだと信じています。

だからこそ、自分の目でちゃんと見て、自分の心でちゃんと感じて、「これが嬉しかった」「この瞬間は確かにあった」と実感できる出来事を、1つでも大切にしていきたいです。 意味の欠如に苦しむ中で、それでも生きる選択をする行為が、やがて自分の生き方を形作るのかもしれません。

問い続けることを受け入れる

残念ながら今の私は、「生きる」ということを強く意識しておかないとすぐ生を見失ってしまいます。 そして、この「意識する」という行為は、大抵の場合、問いを伴います。

完全な答えが得られることは稀で、常に新しい疑念が生まれ、無視できない問いに囲まれてしまいます。 しかし、私にとって「生きる」とは意識的に行うものです。 だからこそ、日々の小さな出来事の中で、自分にとって意味のある瞬間を探し、生きているという実感を少しずつ積み重ねていくことが大切だと思います。

過去との折り合いは、忘れ去ることや帳消しにすることではなく、過去の出来事をどう問いなおし、今の自分に位置づけなおすかというプロセスです。 この作業は、一度で完結するものではなく、何度も揺れながらも問い続ける中で、少しずつ形を変えていくものだと感じています。

出来事やそこから生じた傷は変わりませんが、それをどう捉えるかは時間や環境の変化によって変えられます。 例えば、過去に傷ついた経験が、当時はただの痛みだったとしても、時間が経って振り返ると「この経験があったからこそ、自分はこういう考え方ができるようになった」「この苦しみを知ったから、他者の痛みを理解できるようになった」といった形で、意味を変えていくことができます。

もちろん、無理に"良い"意味に変える必要はありません。 つい過去の苦しみを「意味のある経験だった」として肯定しがちですが、本人がそれを「無駄だった」と感じるなら、その感覚を否定せず、受け入れることも同じくらい大切です。 過去をどう捉えるかは、その人自身の解釈に委ねられるべきであり、それを他者が美化して押し付けることは、ある種の不誠実さを含みます。 「無駄だった」と感じる時間や経験があったとしても、それを認められる社会があることで、人々は無理に過去をポジティブに捉え直さなくても良くなり、その分、本当の自分の気持ちに正直に生きられるのではないでしょうか。 美化が必ずしも救いになるとは限りませんし、苦しい過去をそのまま「そうだった」と受け入れる自由がある社会こそ、いわゆる多様性が実現する場所だと思います。 あくまで、「過去をどう位置付けるかは、今の自分が決められる」という考え方が、時に心の支えになるということです。

また、環境や状況の変化が、新しい視点をもたらすこともあります。 同じ出来事を違う角度から見ることで、それまでとは異なる解釈が生まれることもあります。

こうした変化を受け入れながら、「今の自分にとって、この出来事はどういう意味を持つのか?」と問い続けていくことが、前に進む手がかりになり、そのプロセスが自分を形作っていくのだと信じています。

2024年度SecHack365のラストワークを見届け、残すは成果発表会となりました。今年度も無事に終えることができるようになりそうで、安堵しています。3年間当たり前のようにあったSecHack365もいよいよ卒業なんだなぁと思うと、静かに胸に去来するものがあります。今年度、僕はアシスタントとして、他者に寄り添うことを強く意識して過ごしていました。それは自分が解決できることは何もないかもしれないけど、時間だけはあるから他者に寄り添うことだけはできると昨年度の経験から自負していました。 しかし誰かに寄り添おうとするとき、ついつい日の当たる場所で大きな声を出しているほうにばかり目が行ってしまいます。でも、本当に助けが必要なときは、いつだって静かで、目立たない場所にいるものです。自分は果たして日陰で佇んでいる人にもちゃんと目を向けられていたのでしょうか。昨年度に比べたら意識するようになったとは思いますが、全員に対してその態度を取れていた自覚はなく、ゼロイチで議論するならきっとゼロでしょう。 今この瞬間助けが必要な人は、疲れ切ってしまうと悲鳴の一つをあげる余力もありません。それどころか、追い詰められて、自暴自棄になった姿が、適切な援助を遠ざけてしまうかもしれません。でも、それを自己責任なんだと突き放してしまうのは、極めて残酷です。巡り巡って、未来の自分の首を絞めてしまうんじゃないかと、自分が突き放されてしまう側のことをつい想像してしまいます。だからこそ、自暴自棄な姿を目にしてしまっても、それを受け入れて接することができるようになりたいと思います。 助けを求める余裕すらない人に気づくには、まずは自分ができる範囲を見極め、自分自身に余裕を持つことが必要です。特に、細かい変化や小さなサインに気づくためには、観察する余裕が必要でしょう。これはその通りだと同意できますが、一方で余裕の確保のために見殺しにしてしまう場面も出ているような気もして、このトレードオフとどう向き合っていけばよいのか悩みます。おそらく重要なのは、すべてを救うことは不可能であっても、それは誠実さを失うわけではないと認識することです。自分が関われる範囲で、できる限りのことをした結果、助けを必要としていた人の一部にでも届いていたのなら、それは確かに価値のあることだったはずだと思えるようになりたいです。 また一つ、問い続けることを受け入れるしかないことが増えてしまったなぁ。(2025年2月25日(火)日報)

答えが見つからないという状態そのものを否定せず、「なぜ生きるのか」という問いに完全な答えを求めず、その問いを抱えながら生きるということを赦すことが、自分なりの不条理を受け入れる態度なんだと思います。

美意識を定める

世界に普遍的な意味がなかったとしても、自分にとって大切な価値や目標を見つけて、それを大切にすることが何よりも重要です。 たとえそれが他者にとって些細なものだったとしても、自分自身がそれに価値を感じられるのであれば、それで十分なのです。

このプロセスを支えるためには、美意識を定めることが有益です。 自分の価値観が明確になれば、たとえ世界がどれだけ不明瞭で不安定であっても、何を大切にするべきかがはっきりし、行動の指針になり得ます。

美意識を定めるというのは、単にセンスを磨いて美的感覚を養うという話ではなく、いったい自分はどういう瞬間に心が満たされるのかを自分自身の感覚で選び取るということです。 そしてその過程で、他人に自分の喜怒哀楽を握らせないようにしたり、今ここにいる自分自身を尊重してそこに湧き上がる喜びを大事にしたりすることで、ありのままの自分でいても揺るがない充実感や満足感の獲得につながります。

残酷さに目を向ける

自分の内面と向き合ってきたことで、価値観の核にしっかりと根を下ろしている考えに「苦しみを和らげたい」という願いがあります。 これは単なる理想論でも、無理な正義感でもなく、私自身の痛みや生きづらさを通して得た価値観です。

僕はただ、この世界の残酷さを少しだけ減らすことができれば、それで良いのだと思えてきた。 個々人の持つ痛みや苦しみ、特に自分だけ社会に取り残されていく感覚や苦しみの共有ができない状態から生じる残酷さにもう少しだけ目を向けられるような人間になりたい。目を向けたところで何も変わらないんだろうし、結局自分にできることなんてないんだろうけど、でもきっと、その姿勢が大事なんだと思う。 他者を想う気持ちの中に自分も救われたい感情が混ざってしまうから、自己中心的な考えでまた嫌気が差してしまうけど、目を向ける姿勢に自分を少しだけ赦せるきっかけがあってほしい。 ただ、残酷さは自分自身の外側にあるだけではなく、内側にもあることを忘れないようにしたい。(2024年12月9日(月)日報)

不条理とは、説明のつかない痛みや不幸、理不尽な出来事によって、問いかけても答えのない状態が続くことです。 その中で、「苦しみを和らげたい」と願う姿勢は、不条理な世界に対する1つの反抗であり、同時に、自分の人生に意味を与える行為になっています。

また、ここでいう"内側にある残酷さ"とは、他者に対する無関心です。 自分が当事者でない問題に対しては、どうしても距離を置きやすく、関心を持ち続けるにはエネルギーが要ります。

しかしその無関心は、時に自分でも気づかないうちに、冷淡さや傍観という形で現れ、気づいていたのに見て見ぬふりをするという選択を繰り返すことで、誰かの孤独や苦しみを深めてしまうような残酷さに加担してしまうこともあるように思います。

他者の痛みを完全に理解することは難しいです。 しかし、「これは自分には関係ない」と目を逸らすのではなく、当事者として受け止めようとする姿勢を持ち続けるという日々の小さな選択を積み重ねることが、私の内側にある残酷さに抗うことになると考えています。

プロジェクトマネジメントの基本の一つは”今誰がボールを持っているのかを常に意識すること”だと思うけど、なんか今日は時限爆弾をいかに相手に擦り付けるかゲームをしている自分がいた。う~ん、合理的なそれらしい理由をつけて自分は悪くないと保身に走ることはできるけど、たぶんよくない。なんだろう、自分の道理に反する。自分ひとりで解決できる問題じゃないから協力してくれる他者がいるというのに、これじゃあ協力の欠片もないというか、自分がまったく主体的じゃないというか、責任を持ちたくないから相手に擦り付ける傍観野郎になっていた。他力本願という言葉がよく似合います。そんな自分であると、自分に不都合なことが起こるとあたかもそれを分かっていたかのように言い訳するカスになってしまう。当事者意識をどうやったら持てるようになるかな、always 当事者意識を持てるように意識するところから始めます。(2023年10月2日(月)日報)

不条理に対する救いとして、私は絶対的な希望を見つけることはできませんでした。 しかし救いは外部から与えられるものではなく、心の中に積み重ねられるものであると気づくことができました。 日々の小さな実践から生まれる人間らしい温かさを大切にすることが、私にとっての不条理に対する救いの答えになっています。

"モヤモヤ"の言語化

日報を書き始めた当初は、ただ「やったこと」を記録するだけのもので、自分の感じていることや抱えている感情を、うまく言葉にできずにいました。 それでも書き続けるうちに、言葉が単なる記録ではなく、自分の内面と向き合うための道具であることに気づきます。

"モヤモヤ"としか言いようのない感情を言葉にしようとするたびに、私は自分がどんな言葉を選び、どのように表現しようとしているのかを少しずつ意識するようになっていきました。 日報に綴った言葉たちは、自分の考え方や価値観の変化を写す鏡のような存在になっていきます。

ここでは、そんな言葉の選び方や表現に意識を向けながら、私の中の問いや、何を大切にしていきたいと思っているのかを言葉を通じて振り返り、見つめなおしてみます。

表現という行為そのものが思索の重要な手段

考えは、文字を書くときや人と話をするときにしか、深まりません。 何かを感じたことがあれば書き留めておかないと、すぐに揮発してしまいます。 だから言葉にして表現するということは、モヤモヤとする曖昧な感情を明確にして、一つひとつの思索に輪郭を与えることができる思考を整理する重要な手段なのです。

やったこと以外に日記の欄を設けているのは、人は(主語デカ)文章を書いたときか、人に話したときしか考えは深まらないと考えているからです。それっぽいことを頭の中で考えていても、数分も経てばすぐに頭から消え去ってしまいます。だからその時書きたい口調で、その時書きたい文体で統一感をあまり意識せず書いています。でもなんとなく、僕の気づけない僕らしさがいろいろ滲み出ている気はしています。 日々生きていく中で毎日がハッピーであるということはまったくなく、辛いしんどい日々は平気で訪れます。そういった中でも希望を拾い上げてキラキラとした日記を書く、というのはあまりしていません。ありのまま感じたことを表現し続けています。僕の内面に触れる話もよく登場しています。正直裸を見られるような感じで、読まれるのに恥ずかしさがあります。もちろん、ネガティブな話題を見せられて嬉しい人なんて少ないだろうけど、着飾っても仕方ない気がするし、何より、自分に嘘をついているような気になる。生々しいからこそ、それに批判を受けるとうんと落ち込むので、インターネットの海に流すのではなく、クローズドなコミュニティに日報を投稿するようにしています。(2023年12月31日(日)日報)

また、表現は単なる思考の記録ではなく、思考そのものを促進する役割も果たします。 書きながら新しい発見をしたり、言葉を選ぶ過程で新たな視点が生まれたりすることもあります。

手を差し伸べている感覚そのものが烏滸がましい気がしている。自分にそんな力はないどころか、そもそも”助ける”だとか”手を差し伸べる”だとかいう表現自体が上から目線な気がして気にくわない。自分の行為が相手にとって余計なお節介になっていないかと考えてしまうと、そんな自分をまた赦せなくなってくる。この感覚はどうして起こるものなんだろうか。 無意識の完璧な善意への理想が存在してしまっているのは確かだが、他者との距離感の問題も抱えている気がする。相手の感情を理解するために、その感情に飲み込まれに行こうとしてしまう。共感の無い優しさなんて人を救うことなんてできないから、そうでないと当事者意識が薄れてしまうのではないかと怖くなるんだ。 自分が他者と関わるとき、その場で自分が果たすべき役割を意識しないといけない。手を差し伸べる行為が相手を救うための行為ではなく、今の自分ができる範囲の思いやりを形にしたと意味を問いなおす必要がある。 自分の心を護りながら、他者と繋がり続けるために、自分を赦す第一歩として、“助ける”という言葉を今後”寄り添う”という言葉に置き換えて表現してみることにする。(2024年12月10日(火))

言葉の持つ力

言葉は、発した瞬間に相手の心に届き、時にその人の考え方や気持ちに影響を与えるものです。だから、相手がどう受け止めるかを意識しながら言葉を紡ぐことができる人を尊敬しています。 言葉は単なる情報を伝達する手段ではなく、誰かに想いを手渡すものだからこそ、どんな言葉を選ぶのかが、その人の優しさや誠実さを映し出すと感じます。

ふたばとくんが当たり前だと思って取り組んでいることで周りをどれだけ救っていることか、とにかく自分のことを大切にして、自分を愛してあげてほしいと強く何度も言われた。 自分らしさや魅力というのは、意識的に探しても見つけづらい。周りの人たちとの関係や出来事の中で自然と現れてくる。そして、それに気づいて自分に伝えてくれるのは、本当に貴重で、愛の籠った瞬間である。 他人に自分の喜怒哀楽を握らせないようにして心を安定させるためには、ありのままの自分でいながら、自分が幸せだと感じられる瞬間を増やす必要がある。ありのままで幸せを感じられる自分でいるためには、自分の内側の声に耳を傾け、自分の幸せを自分で定義することが大切になる。 周りの人が自分に向けてくれている希望を素直に信じて、正面から受け取れるようになりたい。卑下は、時には自分を応援してくれる人たちの想いを否定してしまうことにつながりかねない。自分を支えてくれる人たちを大切にしたいという気持ちがあるなら、少しずつでも自己否定を減らしていくことが、その人たちへの感謝や愛情を表していくことになる。受け取るための第一歩は、周りの人からの言葉をありのままに受け止めることであろう。受け取ることで自分が大切にされているという事実を認めていきたい。 今日はお世話になった方にたくさんお会いできて、温かい気持ちになれた一日だった。温かさを共有できるこの巡り合わせを大切にしていきたい。でも日々の忙しさの中でこの感情はすぐに流れて忘れてしまう。今日のような「この瞬間のためにやってきた」と思える時間があったことを何度でも思い出せるようにしたい。また思い起こせるように、また自分に言い聞かせられるように、丁寧に書き起こしておかなければ。(2024年12月14日(土)日報)

より正しい言葉遣い

言葉には、使う人の価値観や前提が内包されるので、私たちがどのように対話し、社会を形成するかに大きな役割を果たします。 言葉を"正しく"使うということは、単に文法や語彙の正確さを追求するだけでなく、その言葉がもたらす帰結や相手の受け取られ方に対しても意識を向けることだと思います。

とはいえ、言葉はとても難しく、"正しく"使いこなすことは容易ではありません。 それでも、言葉は私たちが日常の中で絶えず使わなければならないものでもあります。

一度発した言葉は取り消すことはできず、相手の心に残り、時には関係性や世界のあり方にまで影響を与えます。 自分の発する言葉により、他者を傷つけてしまうことを考えると、とても怖いです。 だからこそ、「なぜこの言葉を使うのか」を考えることが大切であり、この問いを持ち続けることが、より良い言葉の選び方につながるのだと考えています。

他者への敬意の表れとして、この「より正しい言葉遣い」という意識が芽生えてきたと考えていますが、一方で、正しさを意識するほど、自分自身がその正しさに縛られてしまう感覚もあります。 完璧な正しさはどこにもなく、誰かにとっての正しさが、別の誰かには届かないことは十分にあり得ます。

だからこそ、正しさを求めるのと同時に、自分の言葉が"正しくない"かもしれないという可能性にも意識を向けられるような、心の余白を持てるようになりたいです。 この余白は、正しさを手放すというわけではなく、私たちの発する言葉に他者が入り込める場所になると考えています。 正しさを押しつけないことで、読んだ人が「そこにいてもいい」と思えるような、優しく穏やかな空間が生まれるのだと思います。

おそらく、言葉を怖いものだと感じることは重要な感覚であり、これは自分に言葉に対する慎重な姿勢を与えてくれています。 感情から発される勢い任せの雑なコミュニケーションはせずに、丁寧でいることを諦めたくないです。

日々の学びを通じて、言葉の奥深さを味わいながら、少しずつ言葉を乗りこなしていきたいです。

人を救う言葉

言葉は、ただ並べるだけではなく、その背景にある気持ちや意図によって、まったく異なる意味を持ち得ます。 だからこそ、何気ない一言が誰かの心に寄り添うことができたり、逆に傷つけてしまったりすることもあります。

人を救う言葉とは、"その人が必要としているときに適切な形で届けられる言葉"と表現できると思います。 どんなに美しい言葉でもそのタイミングや相手の状況によっては届かないこともありますし、逆にシンプルな一言が心に深く響くこともあります。

人は、自分の内面に深く沈み込むこともあれば、他者の何気ない言葉や気配によって「霧」がわずかに晴れ、浮かび上がることもあって、この流れの中で、僕たちはそれぞれの「夜」を抱えながら生きている。 誰かに寄り添おうと思って投げかけた言葉は、結局のところ、あの時の僕が必要としていた言葉だったんだと思う。だから、きっと、暗闇の中で孤独に打ちのめされながら、ひとり枕を濡らすような夜が増えるほど、僕は優しい言葉をあなたに届けられるようになる。こうして編み上げられる言葉で、いつの日かあなたに寄り添うことができるなら、これでよかったんだと信じたい。(2025年3月9日(日)日報)

私たちは、自分が過去に貰った優しさを通じて、他者への優しさを学んでいくことができます。 誰かの言葉に救われた経験があるからこそ、同じように誰かに優しい言葉を届けたいと思えます。 この連鎖が、言葉の持つ力の1つなのかもしれません。

僕らは不快な感情や自己否定に囚われてしまっているとき,その否定的な感情を排斥して,無かったことにしたくなる.しかしきっと,その感情がそこにあることを認めることが重要なのである.感情には理由があり,それは,その人の過去や経験,価値観に根ざした大切なものだからこそ,決して軽んじられるべきではないはずなんだ. 否定してしまう自分に対し,改善や解決が必要であると感じてしまうこともあるが,不快な感情は解決されるべき問いではなく,その瞬間のあなたを形成している一部でもある.むしろ,それを抱えながらも歩み続けている事実こそが,あなたの強さや美しさであると信じたい. だからこそ,「それでいいんだよ」と,抱えたままで良いという姿勢が救いになるのであれば,僕はあなたに言葉を変えて何度でも伝えていきたい.その感情があなたを縛るのではなく,あなたがその感情を持ちながらも,ありのままで幸せを感じられて,自由で居続けられる状態を目指して欲しい.あなたと一緒に対話を重ねる中で,少しでもそのような感覚を身に着けられるなら,僕はとても嬉しい.(2025年2月1日(土)日報)

他者の苦痛に対峙する

深い苦しみに直面している人にとって救いとなり得るのは、単なる優しい言葉ではなく、共感に根ざした言葉だと考えています。 共感は相手の痛みや苦しみを自分自身のものとして感じ、受け止める行為であり、その体験を言葉に乗せて伝えることで、相手は「自分は理解されている」と感じ、孤独感や疎外感が和らぐのかもしれません。

人を救うのは優しさではなく共感なんだろうなというのがこの1年くらいの気づきである.共感のできない他者が無理しないでねと言っても,当人にはなんの解決にもならないのである.優しさは沈んでしまわないよう支えてあげることはできても,一度沈んでしまったものを引き上げることまではできないのかもしれない.共感の無い優しさを嘘や偽物とまでは否定しないけれど,驚くほど響かない. 寄り添うのに必要なのは共感で,そこには優しさは必ずしも必要ないのかも知れない.心が沈んでいるときは認知の歪みが起こっていて,自分の状態,責任,考えを言語化できないことが多い.わかってほしいと主張する割には,自分に能力が無いからだと言語化を放棄して片づけてしまうこともあると思う.自分の気持ちを代弁してくれるかのような存在があると何か負担が和らぐ気がするし,それが救いになり得るのはよくわかる. ダークなオーラを身にまとっているときはとにかく自分に合わない意見を否定したくなる.人の意見を拒絶するというよりかは,話を聞いたうえで否定するための粗を探して理論武装をしがちだ.親身に寄り添ってくれている他者に対してそんな鋭い牙を向けたくない気持ちと,それでも反論したくなる気持ちでいっぱいになる.すごく苦しい. みんなはどうして自分のことをそんなに信じてあげられるのだろう.この世界で生きることにどう興味を持ち続けているのだろう.新しい砌に,晴れ晴れしく生きる覚悟はあるか?僕には無い.(2024年5月22日(水)日報)

残酷な状況にある人に対しては、まずは聴くことが大切です。 相手の言葉を否定せず、ただその心の叫びに寄り添うことで、彼ら彼女ら自身が自分の内面を整理する助けになる場合があります。そして、無理に励ましたり、解決策を押し付けたりするのではなく、相手が感じている痛みや混乱を認め、「その苦しみはあなたが感じるに相応しいものだ」と共感する姿勢を示すことが求められます。

共感するということは、必ずしも明るい希望やポジティブな未来を約束するものではありませんが、その瞬間において相手が孤独ではないという安心感を与える力があります。

"われわれ"を拡張する

言葉で何かを表現するときに、私は主語や目的語を強く意識して選択するようにしています。 これは単なる気分や文体の変化ではなく、読み手との間の連帯の可能性を意識しているものです。

連帯という言葉を安易に使ってしまっている気もしますが、例えば"僕"ではなく"僕たち"と表現することで、同じような境遇の人に共感し、言葉の中に含めようとしているのなら、それは連帯を生み出す1つの縁とも言えるのかなと思います。

あくまで日報は自分の感じたことについて書いてきたものですが、書く行為の中で「苦しみを和らげたい」という願いが育まれてきたのは事実だと考えています。 言葉にしたところで現実は何も変わらないし、苦しみを完全に消し去ることはできません。 それでも、感情的な紐帯によって、痛みを共有してあなたと共に向き合うことで少しでも救われたような気持ちになるのなら、それで十分なんだと思います。

自分の感情を整理して言葉にすることは、単に記録を残すことだけではなく、自分自身との対話でもあり、心を支える手段でもあるのです。

自分を護る習慣

毎日の規則正しい習慣は、不確実な未来に対する小さな安全地帯のようなものとして機能して、ある程度のものごとをやり過ごしてくれます。 心が波立っていると、気分が行動を支配してしまう状態になってしまいますが、習慣があることによって、行動が気分を支えてくれるようになります。

また、習慣は、"自分を否定する自分"に対する有力な反証の手段として機能します。 自分を否定する感覚というのは、「何もしていない」という気持ちから来ることが多いです。 でも、習慣として目の前のやるべきことをきちんとこなしていけば、「何もしていない」という感覚自体が、事実として矛盾することになります。

みんな、怖いんだよな。臆病なのは自分だけかと思っていたこともあるけど、強がっていたり隠していたり、見えていないだけで周りの人も裏ではすごく繊細でか弱い存在だったりする。オレたちは臆病なもんだから、どうしても無理なことはたくさんあるんだと受け入れるところから始まるんだ。 堂々とした立ち振る舞いをするのは無理なんだ。自信を持てないことを恥ずかしいと思うくらいなら、それを受け入れて戦略を練る方がオレたちには合っている。なら、臆病の裏返しでとにかく続ける努力やひたむきな誠実さはオレたちの武器だと言ってしまってもいいのだろうか? ある瞬間は自分を強く保てそうな気がするが、すぐに心は折られる。だから習慣化によって行動のコストを下げたり何かを新しく試すハードルを下げたりして、日報なりマンダラートなりで振り返ることで自分を見失わないようにするライフハックがあるんだ。手段はおそらくなんだっていいんだろうけど、とにかく、自分を護ってくれるものがあることが大事なんだ。他者が何を言っても響かないということもそろそろ認めたほうがいい。自分の幸福を他人の中に見出そうとしている時点でダメなんだ。うっすらとした閉塞感による生きづらさを取っ払いたいなら自分の喜怒哀楽をもう誰かの思惑に奪わせちゃいけないんだ。(2024年5月20日(月)日報)

自分との約束を守り続ける

やるべきことを放置し続けると、未完了タスクが脳内メモリを占有していき、精神的なリソースを奪うようになります。 これは単なる罪悪感に留まらず、自分に対する信頼を蝕むという根の深い影響を持っています。

自分との約束を守ることは、自分を裏切らないことでもあります。 他者に向ける態度と同様に、自分に対しても誠実でいなければ、自分自身と信頼関係を築くことはできません。

でも逆に、ほんの少しのことでも「ちゃんとやった」と思える体験があると、それは心のどこかに小さな支えを作ってくれます。 「今日は何もできなかった」と思う日の中にも、「いや、あれはちゃんとやったな」と思える一点があるだけで、落ち込みの深さは違ってくるものです。 これが、自己否定に歯止めをかけてくれます。

以前は、「なんとかなる」という言葉に楽観や現実逃避の匂いがして、苦手意識を持っていました。 でも今は、小さくても「ちゃんとやった」という手応えを確かに何度も自分の中に刻めている人なら、「きっとまたどうにかできる」と自然に思えているのかもしれないと感じます。 これは無根拠な希望ではなく、根を張った確信に近いものになっているはずです。

逆に言えば、自分との約束を守り続けることができれば、未来の自分が困難に直面したときに「なんとかなる」と思えるのかもしれません。 そう思えるだけの支えを、日ごろから積み重ねていくと解釈ができます。 未来に対する希望は、今この瞬間の小さな誠実さの延長線上にしか存在しないのかもしれません。

ただいま。8月からストリークが切れてしまいました。7割くらい書いて寝落ちしてしまう日々がずっと続いて、書ききれなかった分を取り戻すために、それらしいことを書いて日報としての体裁を保とうとするのは、恐ろしい労力が必要でした。さすがに日報を追いつかせようとするのに限界が来て、書けていない日は、その日あったはずの出来事をすっかりと忘れてしまうような日もできてしまった。 最近はかなり酷い生活を送ってしまっている気がする。生活は乱れ、記録を取っていないものだから、数日前の出来事をすらも忘れちゃって、空っぽのまま、あっという間に時間が過ぎていってしまうように感じる。何かを吐き出しつつもしっかりと生きていた日々のほうが振り返ったときに充実していたように思う。日報の書けなかった日は、今後振り返えろうとしても思い出すことは難しい。そのとき感じた何かが記録を取らないことですぐに昇華してしまうのは、結構寂しい。恐ろしくネガティブな表現でさえ、他者からの視点のように後日冷静に読み返すことができるのは、まさしく記録の強味で、当時の叫びを眺めるのは結構面白かったりする。 当たり前のことを当たり前にやることが何より大事なことの一つで、僕にとって日報は、内省の機会創出でありつつも、タスク整理ができたり、この世界に佇んでいるものに目を向けられるようになったりしたもので、やっててよかったなという感情しか湧いてこない。まぁまぁ、続いていたものが一度途切れてしまうと「あーあ。」となってすべてがどうでもいいやと塞ぎ込んでしまうけど、ここから1点でもよくした生活を送ってみようと考えると、再開しない以外の選択肢はないんだろうなぁ。こう思えているのはストリークを切らしたからなのだろうか。ちゃんと朝起きて、一日をしっかり生きて、寝る前に日報投稿して寝る、当たり前の生活を続けて生きたい。(2024年9月10日(火)日報)

結局、自分で自分を好きになれるかどうかは、何か特別な才能があるだとか、誰かに認められただとか、ナニモノになれただとかでは決まらないと感じます。 「自分が今やれることをやっているかどうか」、これだけが、自分への信頼を育てる唯一の方法です。

人と比べてしまう瞬間というのは、いつだって唐突で、自分が無防備なときにやってきます。 でも、そういうときにこそ、比較や数字に引きずられずに、「今日の自分がやったこと」に目を向け、そこに誇りを持てるかどうかが、とても大事です。 当たり前のことを当たり前にやれたときが、一番気持ちいいものです。

また、「自分を侮らない」「自分を卑下しない」と口にすることは簡単ですが、実践するのは本当に難しいです。 でもだからこそ、「やった」「やりきった」「手を抜かなかった」という小さな実感の積み重ねが、自分を侮らないための確かな盾になってくれます。 誰にも褒められなくても、誰にも見られていなくても、自分だけはちゃんと知っています。 こうやって、一つひとつ積み重ねていったものが、やがて自分の心の中で静かに光ってくれるのだと思います。

#丁寧な暮らし を演じる

日々の生活に追われる中で、「今日はこれでいいや」というものが積み重なっていくと、無意識に「自分のだからまぁいいか」という態度に変化していってしまうことがあります。 「誰かのために」と思うと頑張れることはありますが、どうも自分のことになると雑に扱ってしまいがちです。 しかし本来、自分こそが最も長く自分と付き合っている相手であるので、誰よりも丁寧に接するべきなのは、自分自身なのです。

#丁寧な暮らし というのは、例えば、朝起きてカーテンを開けること、料理を丁寧に盛りつけること、食べる前にいただきますを言うこと、洗濯物を綺麗に畳むこと、机の上を綺麗にすること、お気に入りの香りを身にまとうこと、いいなと思った瞬間を記録することなど、 "ちょっとしたこと"の積み重ねです。 どれも簡単にできることかもしれませんが、意識しないとつい見過ごしてしまいます。

今この瞬間に少しだけ注意を向けて #丁寧な暮らし を演じることで、自分を大切にする習慣を身に着けていきたいです。

生きていくことを愚直に果たす

私は、愚直に生きるということを"規則正しい生活"として、地に足をつけた形で捉えています。 華やかでなくても、やるべきことを正しくきちんと日々積み重ねるような日常に自分を置くということは、周囲の雑音や感情の波に呑まれることなく、自分のリズムを持ち続けるということでもあります。

誰かに褒められた時の高揚感や、誰かに貶された時の焦燥感に、自分の価値を委ねてしまうと、心が落ち着く場所を見失ってしまいます。

でも、「自分はどう在りたいのか」という静かな1本の軸があれば、感情の浮き沈みに吞まれずに済みます。 例えば「今日はちゃんと朝起きられた」「今日はやるべきことをすべて片づけた」「今日はしっかりと休んだ」というような、ごく小さな記録の積み重ねが、そのまま自分を支えてくれるようになります。

習慣と記録は、自分で自分を見失わないための手がかりであり、自己評価の基準にもなります。 それは、自分を肯定するというよりも、「何もしていない」と自分を否定してしまう内なる声に対して、確かに否を示せるという意味で、自分を護る術でもあります。

また、「愚直」という言葉には、要領が悪いといった響きがあるかもしれません。 しかし実際には、理想だけで走らず、現実から逃げず、手を動かすことを諦めないという姿勢を指します。 目の前の小さな選択を丁寧に、誠実に積み重ねようとすることに派手さはありませんが、それらは確かに意味のある営みであり、それこそが「愚直に生きる」ということなのだろうと解釈しています。

誰にも見られていない日常の中で、それでも「ちゃんとしよう」と思い続け、「完璧じゃなくてもいい、でも投げ出さない」という日々の選択が、いずれ自分自身の重みとなり、支えになり、信頼になっていきます。

自由に生きるということは、他人の評価に縛られずに生きることでありますが、それと同時に、「自分で自分を侮らない」という視点を持ち続けることでもあると感じています。 誰にも賞賛されなくても、誰にも気づかれなくても、それでも自分だけが証人として「私はちゃんとやってきた」と言えるということが、自分の人生に対して責任を持つということなのかもしれません。

規則正しい生活を続けながら、自分がどう在りたいのかという軸を持ち続けることができれば、外部の評価に翻弄されることなく、もっと自由に、自分らしく生きられる気がしています。

今日をどう過ごそうか

規則正しい習慣が多くのことを平準化してくれる一方で、心の奥底には「それでも平準化されきらないもの」が存在し得ます。 それは、自分が何を大切にしているのかという問いに大きく関わる部分なのかもしれません。

これは文脈の無い話だけど、誠実な人ってむっちゃ素敵じゃないですか? コンビニの店員さんに「ありがとうございます」を毎回言える人だったり、誰も見ていないところでも行儀よく振る舞ったり、自分にさえ嘘をつかなかったり、他人に対する敬意を持って自己の価値観や信念に忠実で居続けられる人はとっても素敵だなと思っています。 その誠実さはきっと周りの人に安心感を与えて自己の内面に平穏をもたらしてくれるものだと思っているので、バカ真面目と揶揄されようが、できるだけ誠実で居続けたいなと思っています。(2024年4月12日(金)日報)

何のために生きているのかと問われると難しいですが、「誠実に生きる」という姿勢には妙に惹かれます。 これには、 無理に何かを証明したり、他者の価値観に合わせたりせず、とにかく自分自身と向き合いたいという想いがあるからなんでしょうか。

自分が今できることを一つひとつ丁寧に行うために、自分がその瞬間に対して正直であり続けたいです。 これは目の前の自分の気持ちだけでなく、他者や世界に対しても真摯に向き合いたいということでもあります。 不条理を抱えたまま、それでも自分のできる選択をするという態度が合っていると感じるのであれば、この感覚は信じてあげたいです。 これらは、どんな状況でも自分らしくいられるための大切な拠り所になるような気がします。

では、誠実に生きるとはどういうことなんでしょうか。 誠実に生きることは、何か特別な行動をすることではなく、むしろ自分の中で抱える苦痛や混乱、不条理への疑問をそのまま抱えつつ、それでも「今日をどう過ごそうか」と問い続けることなのだろうと、一旦着地しています。

しかし誠実に生きるというのは、自分の弱さや未熟さ、さらには内なる悪に対して正面から向き合うことからは避けられないので、ものすごくしんどいことです。 しかも他人からは、つまらない人間だと思われているかもしれません。

でも、自分が感じてきた心の痛みや孤独感が、他者の苦しみに対する共感を育んでいるような気もします。 私の人生の中で経験している「生きづらさ」や「恥ずかしさ」は、他者の抱える苦しみや不安への理解を深める源にもなっているような気もして、その結果、「苦しみを和らげたい」という願いを持っていることがわかってきました。

不条理な現実の中で見えてしまう不誠実さや理不尽さ、あるいはそこから生じる自分だけが社会に取り残されていく感覚や苦しみの共有ができない状態は、残酷であり、自分はこの残酷さを減らすことがしたいと思えるようになってきました。

大層なことを述べていますが、残酷さを減らすための社会活動をするという訳ではなく、仕事や生活を通じて自分ができる範囲で周りの人に優しくするというスタンスで生きていくつもりです。 結論どんな仕事をしようが、他者に寄り添う姿勢や常に誠実な態度を選択して、目の前で起きている残酷さを少しだけ減らすことができたら、それでもう十分なんだと思います。

つまり、生きる意味を探そうとすることよりも、どう生きるかを自分で選び続けることが、不条理な世界への自分なりの反抗であり、これが生きることそのものになるのです。

おわりに

最後まで読んでくださってありがとうございました。

自己肯定感の低さや自己否定的な感情に正面から向き合うことは本当に苦しい作業です。 でも、課題を不明確にしたまま、漠然とした不安に駆られ続けるのにはもう飽きました。

日報に記録されている過去の逡巡や葛藤、それらを記録することによって残される軌跡は、今の自分にとっての自己理解を深め、次へ進むための貴重な糧となっています。 本稿の執筆にあたり、自分にどのような変化があったのかを整理する貴重な機会になりました。

私はこの3月で学生期間を終えますが、次は自分に選択肢を残せられそうな環境に進むことにしました。 渇望が止まない頃は「自分の納得のできる地獄を選ぶこと」こそが美学であると考えていましたが、私の場合、"地獄に進むことが自分の納得のできる選択である"と解釈してしまっていました。 苦しい道をデフォルトに選ぶことを避けるという、一見逃げの選択ですが、これは長期的な生存戦略のために今の自分に無理のない選択をしたということであります。

人生の勢いがどんどん止まっていく感覚はあり、過去の自分は現在の自分を軽蔑するかもしれません。 6年間情報技術を学んできた結果こういう選択の仕方をするんだと、自分でも少し驚きますが、現在私がいる地点は、思索を巡らした先に辿り着いた点であることは確かなので、この選択を自分の中で肯定できるようひっそりと誇れるようになりたいと思います。

恥ずかしくなんかひとつもないよな。

たとえうまく選べなかった過去があったとしても、自分で選ぶ日々の行動を大切にすることが、私のこれからの道を形作っていくと信じて生きていきます。

3年間本当にお世話になりました。 お世話になりました皆さま、またどこかでお会いしましょう。

SecHack365へのご応募、お待ちしております。